iPAS AI應用規劃師 經典題庫

L22404 大數據隱私保護、安全與合規

出題方向

1

大數據隱私保護基本概念與法規

2

數據匿名化與去識別化技術

3

差分隱私 (Differential Privacy)

4

聯邦學習與隱私保護AI

5

大數據安全威脅與防護措施

6

數據治理與合規性框架

7

AI倫理與大數據隱私的交集

8

雲端大數據環境下的隱私與安全

#1

★★★★★

歐盟的「通用數據保護條例」(General Data Protection Regulation, GDPR)賦予數據主體多項權利,下列何者「不」屬於GDPR賦予的主要權利?

答案解析

GDPR旨在賦予個人對其數據更大的控制權。主要權利包括訪問權、更正權、刪除權(被遺忘權)、限制處理權、數據可攜權、反對權以及與自動化決策和剖析相關的權利。GDPR強調數據最小化和儲存限制原則,即數據的收集和保存應有特定目的且有時間限制,因此不存在「數據永久保存權」。恰恰相反,數據主體在某些情況下有權要求刪除數據。

#2

★★★★

在大數據集中移除所有直接標識符(如姓名、身分證字號、電話號碼)後,數據是否就能保證完全匿名且無隱私風險?

答案解析

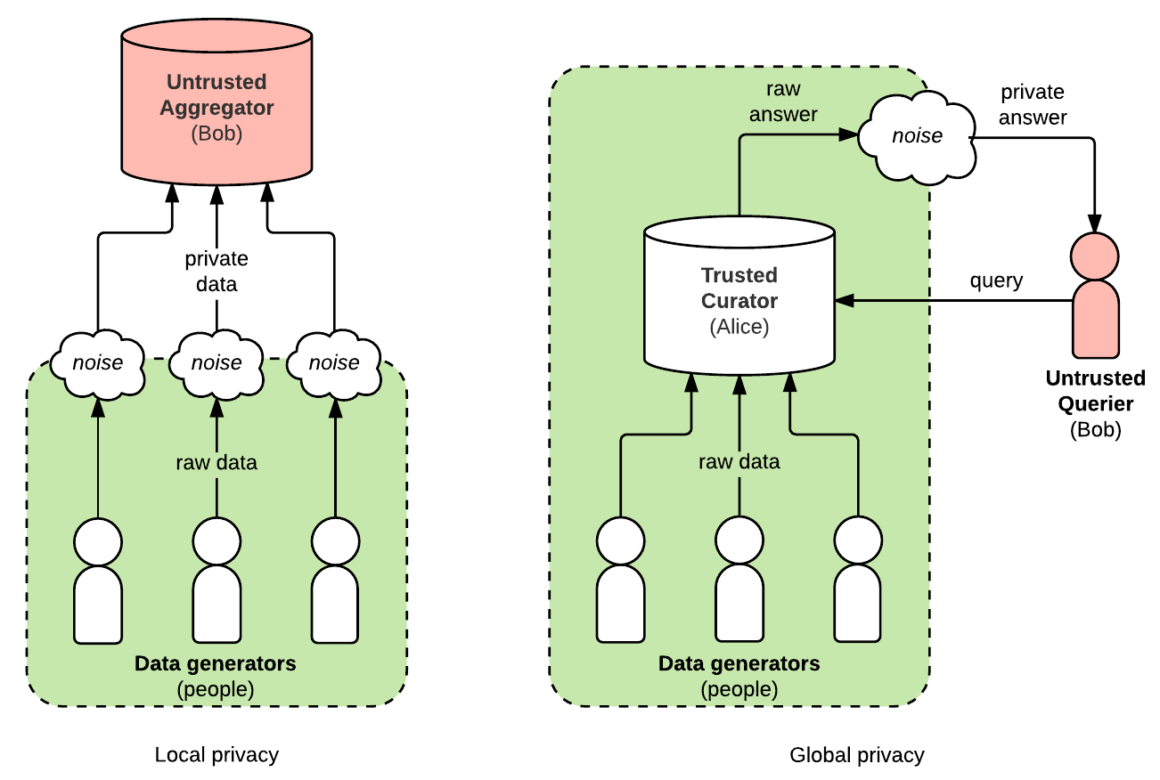

僅移除姓名、ID等直接標識符的過程通常稱為假名化(Pseudonymization)而非完全匿名化。數據中仍然存在的其他屬性,如出生日期、郵遞區號、性別等,被稱為準標識符(Quasi-identifiers,

QIs)。當這些QIs組合起來時,即使沒有直接標識符,也可能唯一地指向某個特定個體(例如,某個郵遞區號內特定出生日期和性別的人可能只有一個)。攻擊者可以利用公開數據或其他輔助訊息,通過鏈接攻擊(Linkage

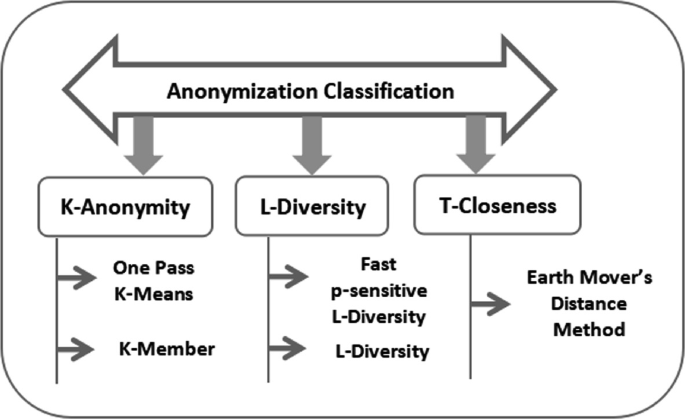

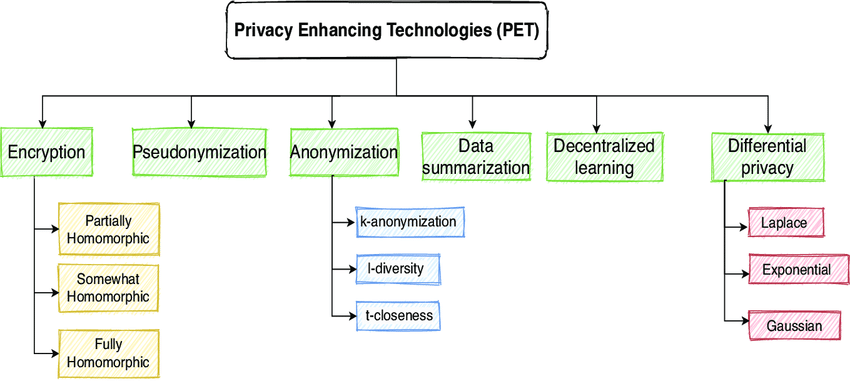

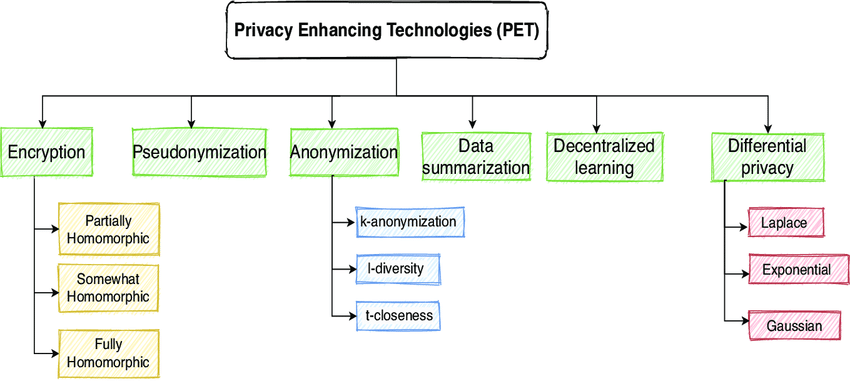

Attack)來重新識別這些個體。因此,真正的匿名化通常需要更進一步的技術,如k-匿名、l-多樣性、t-相近性或差分隱私,來處理準標識符帶來的風險。

#3

★★★★★

差分隱私(Differential Privacy)提供了一種數學上可證明的隱私保護。其核心思想是通過向查詢結果或分析過程中添加什麼來實現隱私保護?

答案解析

差分隱私的核心機制是在數據分析或發布過程中(例如,計算統計數據、訓練機器學習模型的梯度更新)注入隨機噪聲。這種噪聲的大小是根據所需隱私保護級別(由隱私預算參數ε控制)和查詢本身的敏感度(Sensitivity)來精確校準的。添加噪聲的目的是使得最終輸出的結果對於數據集中是否存在任何單一個體的數據不敏感。換句話說,無論某個特定個體是否在數據集中,查詢結果的機率分佈都非常相似,從而保護了個體隱私。

#4

★★★★

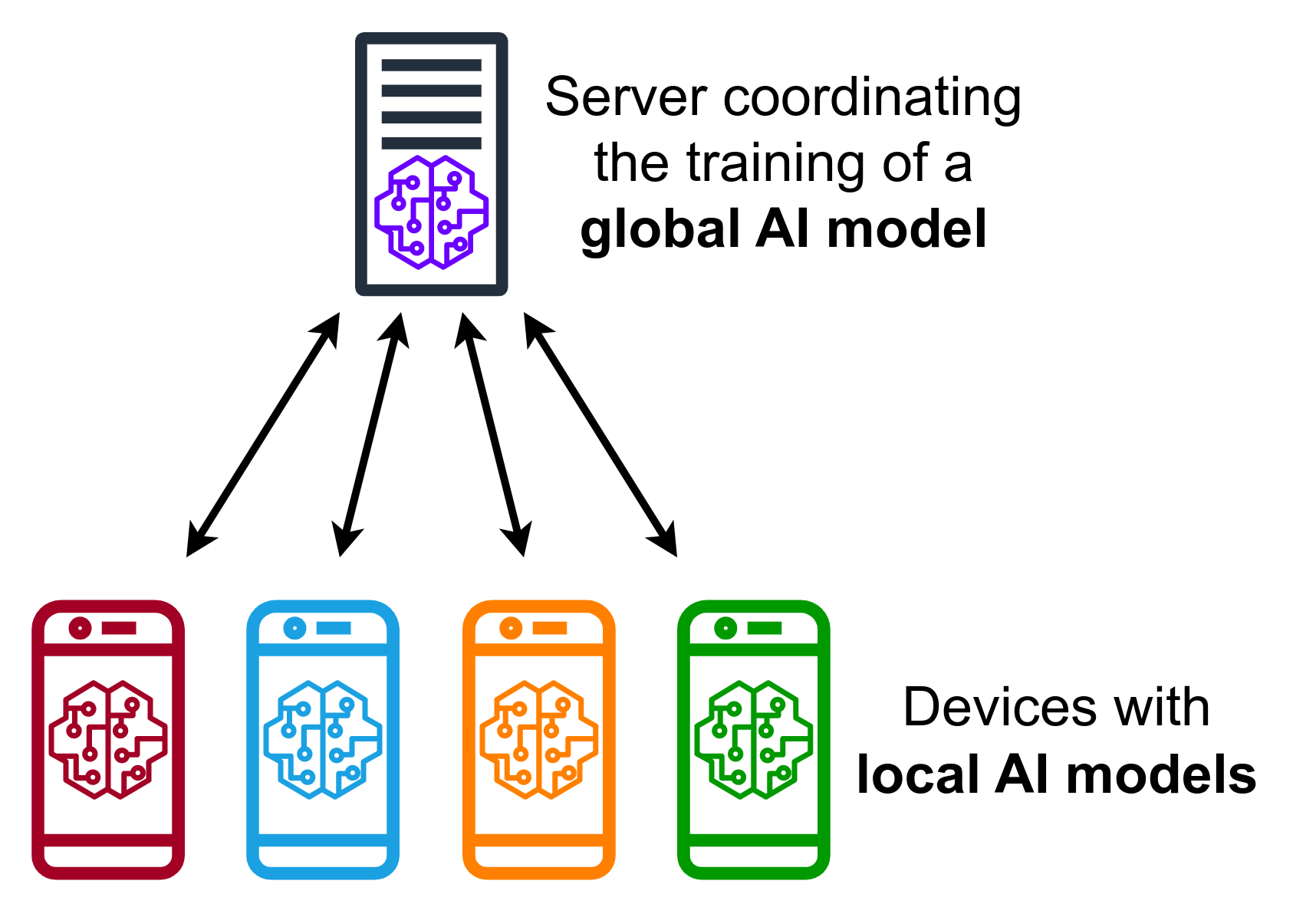

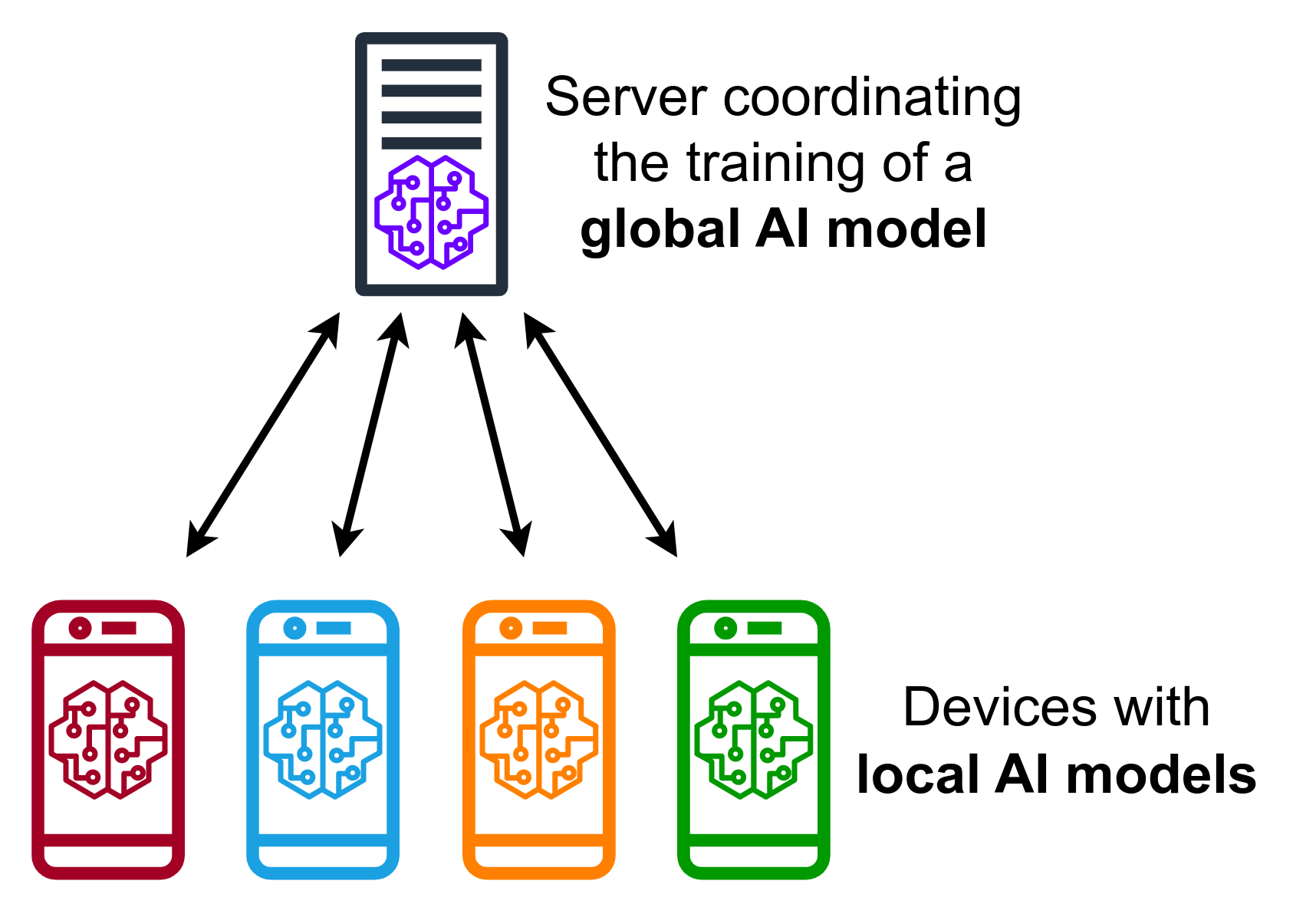

聯邦學習(Federated Learning)作為一種隱私保護機器學習範式,其關鍵特徵是什麼?

答案解析

聯邦學習的核心思想是「將計算移動到數據」,而不是傳統的「將數據移動到計算」。在聯邦學習中,多個持有本地數據的參與方(客戶端)協作訓練一個共享的機器學習模型,而無需共享他們的原始數據。典型的流程是:中央伺服器將初始模型分發給客戶端,客戶端使用本地數據進行訓練並計算模型更新,然後將這些更新(而非原始數據)發送回伺服器。伺服器聚合來自多個客戶端的更新,以改進全局模型,然後再將更新後的模型分發出去。這個過程迭代進行,直到模型收斂。由於原始數據保留在本地,聯邦學習顯著增強了數據隱私。

#5

★★★★

在大數據環境中,為了防止未經授權的用戶訪問敏感數據,最基本的安全控制措施是?

答案解析

保護大數據安全的第一道防線是確保只有合法的、經過授權的用戶才能訪問數據。這需要兩個關鍵機制:1. 身份驗證:確認用戶的身份(你是誰?),通常通過密碼、多因素認證等方式。2. 授權/訪問控制:確定經過驗證的用戶被允許執行哪些操作(你能做什麼?),例如讀取特定數據集、修改數據、執行分析任務等。這通常通過訪問控制列表(ACLs)、基於角色的訪問控制(RBAC)或基於屬性的訪問控制(ABAC)來實現。沒有有效的身份驗證和訪問控制,其他安全措施(如加密)的效果也會大打折扣。

#6

★★★★

數據治理(Data Governance)框架在企業大數據管理中扮演重要角色,其主要目標不包括下列哪一項?

答案解析

數據治理是一個涵蓋數據資產管理的策略、流程、標準、政策和控制的框架。其核心目標是確保數據在其生命週期中被妥善管理,以支持業務目標、降低風險並確保合規性。這包括提高數據品質、定義數據擁有者和管理員、建立數據目錄和元數據管理、實施數據安全和隱私政策、監控數據使用以及確保遵守外部法規。數據治理強調數據的價值和負責任的使用,而不是盲目地最大化數據收集量。數據最小化原則(只收集和保留必要的數據)通常是數據隱私和治理的重要組成部分。

#7

★★★★★

AI模型在訓練過程中可能從大數據中學習到並放大了社會偏見(例如,性別、種族偏見),導致其在應用中產生不公平的結果。這主要涉及到哪個AI倫理原則的考量?

答案解析

如果用於訓練AI模型的歷史大數據本身就反映了社會中存在的偏見(例如,某些群體在數據中代表性不足或被賦予了刻板印象),那麼模型很可能會學習到這些偏見,並在做出預測或生成內容時重現甚至放大它們,導致對特定群體產生不公平或歧視性的結果(例如,在招聘、信貸審批、人臉識別等應用中)。確保AI系統的公平性,避免產生歧視性影響,是AI倫理中的核心關切之一,需要從數據收集、模型設計、訓練和評估等多個環節進行考量和干預。

#8

★★★

將包含敏感資訊的大數據遷移到公有雲平台(如 AWS, Azure, GCP)進行儲存和分析時,需要考慮「責任共擔模型」(Shared Responsibility

Model)。以下關於雲端安全的描述何者正確?

答案解析

雲端安全採用責任共擔模型。雲服務提供商通常負責「雲本身」的安全,包括其全球基礎設施的物理安全、硬體、網路以及部分基礎服務(如儲存、計算的底層)。而客戶則負責「在雲中」的安全,這包括:客戶數據的內容和安全(如加密、分類)、操作系統、網路和防火牆的配置、身份和訪問管理(IAM)、以及客戶部署的應用程式和平台的安全。具體的責任劃分會根據使用的雲服務模型(IaaS, PaaS, SaaS)有所不同,但客戶始終對其數據的安全負有重要責任,不能完全依賴提供商。

#9

★★★★

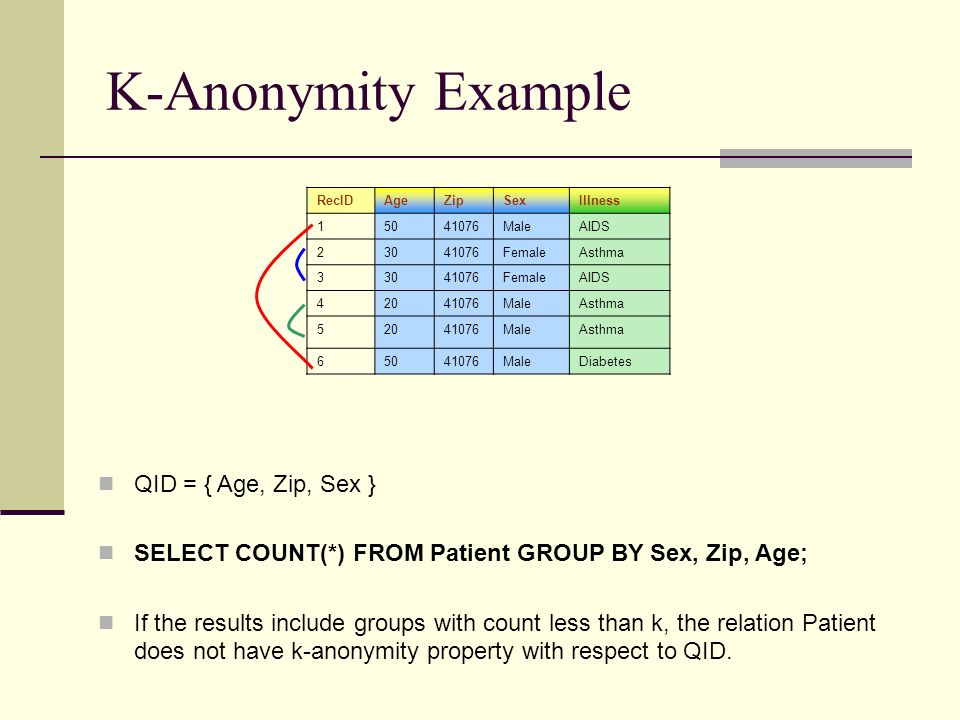

k-匿名(k-Anonymity)是一種數據匿名化技術,其目標是確保數據集中的每條記錄對於一組準標識符(Quasi-identifiers,

QIs)來說,至少與其他多少條記錄無法區分?

答案解析

k-匿名的定義是,在經過匿名化處理(通常是通過泛化或抑制某些屬性值)後的數據表中,對於任意一組選定的準標識符(如年齡、性別、郵遞區號),任何記錄的準標識符組合都至少與其他 k-1

條記錄的準標識符組合完全相同。換句話說,每個記錄都隱藏在一個至少包含 k 個相同準標識符記錄的「等價類」(Equivalence Class)中。這樣,攻擊者即使知道某個個體的準標識符值,也無法將其唯一地從這 k

個記錄中區分出來,從而降低了鏈接攻擊的風險。k 的值越大,匿名保護程度越高,但數據的精確性通常會越低。

#10

★★★★

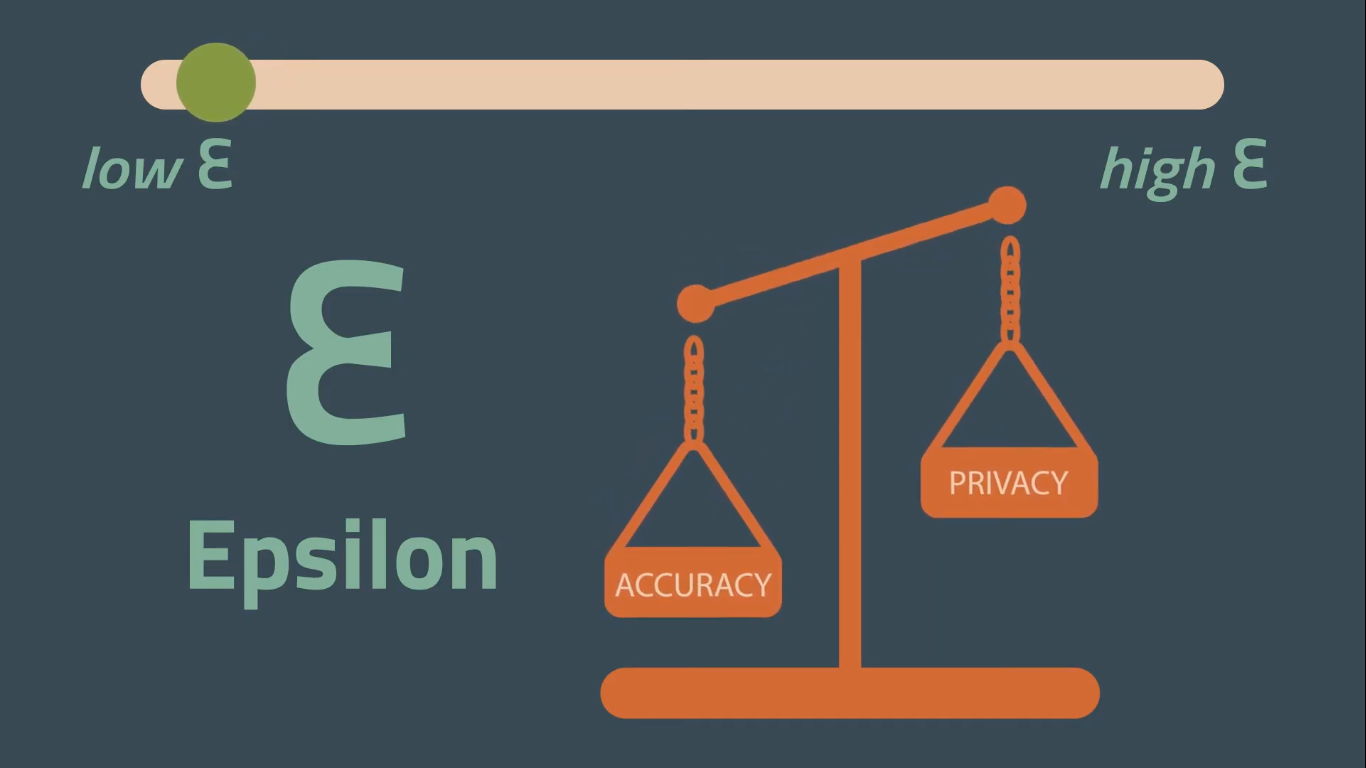

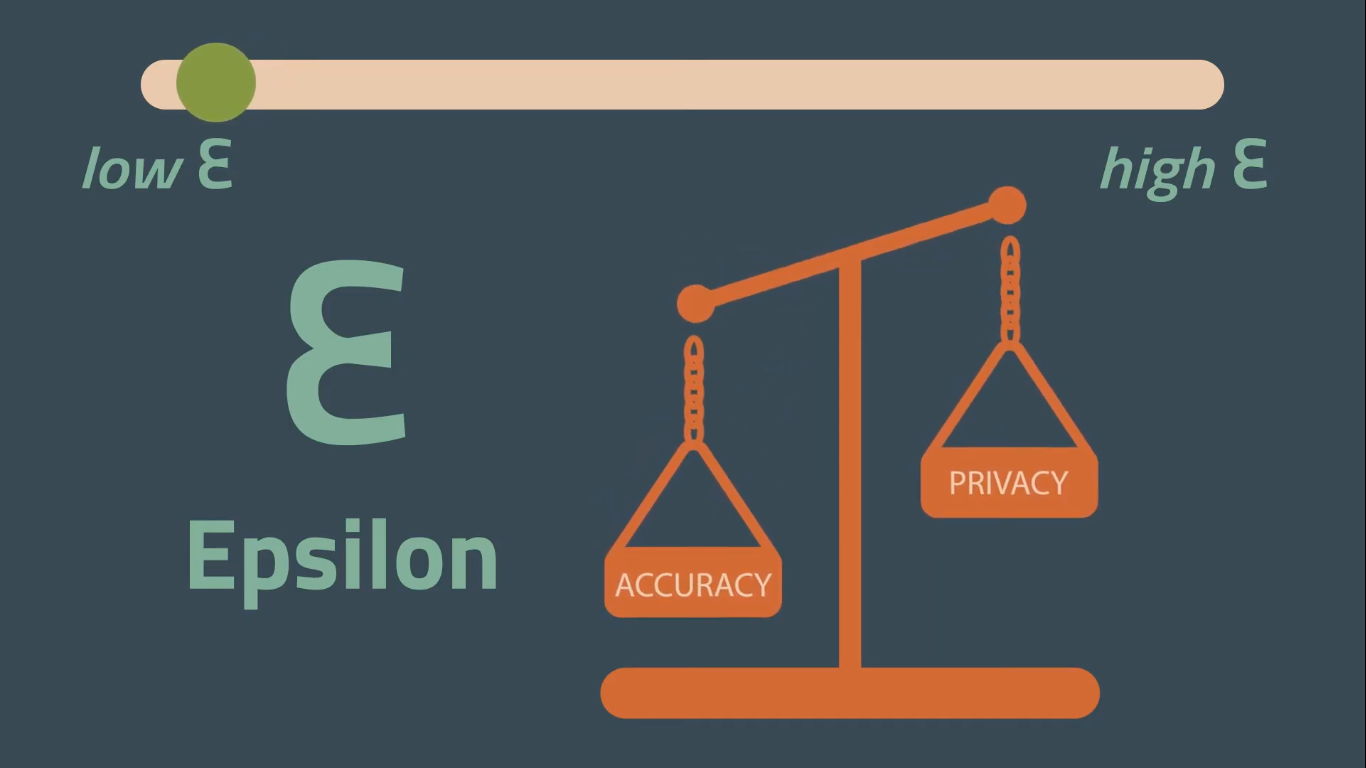

在差分隱私中,隱私預算(Privacy Budget, 通常用

ε 表示)的意義是什麼?

答案解析

隱私預算 ε 是差分隱私框架中的核心參數,它量化了單個個體數據的存在與否對輸出結果機率分佈的最大影響程度。ε 值越接近

0,表示個體數據對結果的影響越小,隱私保護水平越高。但這通常需要添加更多的隨機噪聲,可能會降低分析結果的準確性或效用。反之,ε 值越大,隱私保護越弱,但結果的效用可能更高。選擇合適的

ε 值需要在隱私保護和數據效用之間進行權衡。此外,隱私預算是可組合的,多次查詢會消耗累積的預算。

#11

★★★

與傳統的集中式訓練相比,聯邦學習在處理大數據時的一個主要挑戰是?

答案解析

聯邦學習雖然有隱私優勢,但也面臨獨特的挑戰:(1) 系統異質性:參與的客戶端設備(如手機)在計算能力、存儲空間、電量和網路連接穩定性上可能差異巨大。(2) 數據非獨立同分佈(Non-IID):不同客戶端的本地數據分佈可能很不一樣(例如,不同用戶的輸入習慣不同),這會給模型聚合帶來困難。(3)

通信成本:雖然不傳輸原始數據,但頻繁傳輸模型更新也可能產生顯著的通信開銷,尤其是在客戶端數量眾多或網路狀況不佳時。(4)

客戶端可用性:客戶端可能隨時離線。應對這些挑戰是聯邦學習研究和實踐中的重要課題。

#12

★★★

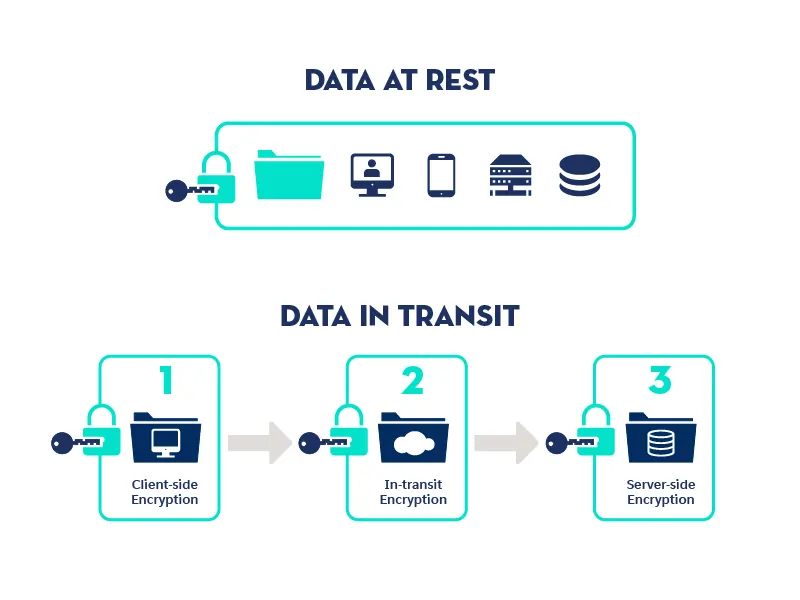

數據加密(Data Encryption)是保護大數據安全的重要手段。靜態數據加密(Encryption at Rest)指的是對什麼狀態下的數據進行加密?

答案解析

數據加密根據數據所處的狀態可以分為三類:(1) 靜態數據加密(Encryption at

Rest):保護儲存在物理介質(如硬碟、SSD、磁帶、雲儲存)上的數據,防止未經授權的物理訪問或儲存介質丟失導致的數據洩露。(2) 傳輸中數據加密(Encryption in

Transit/Motion):保護數據在網路(如公網、內部網路)中傳輸時的安全,防止被竊聽或篡改,常用技術如 TLS/SSL。(3) 使用中數據加密(Encryption in

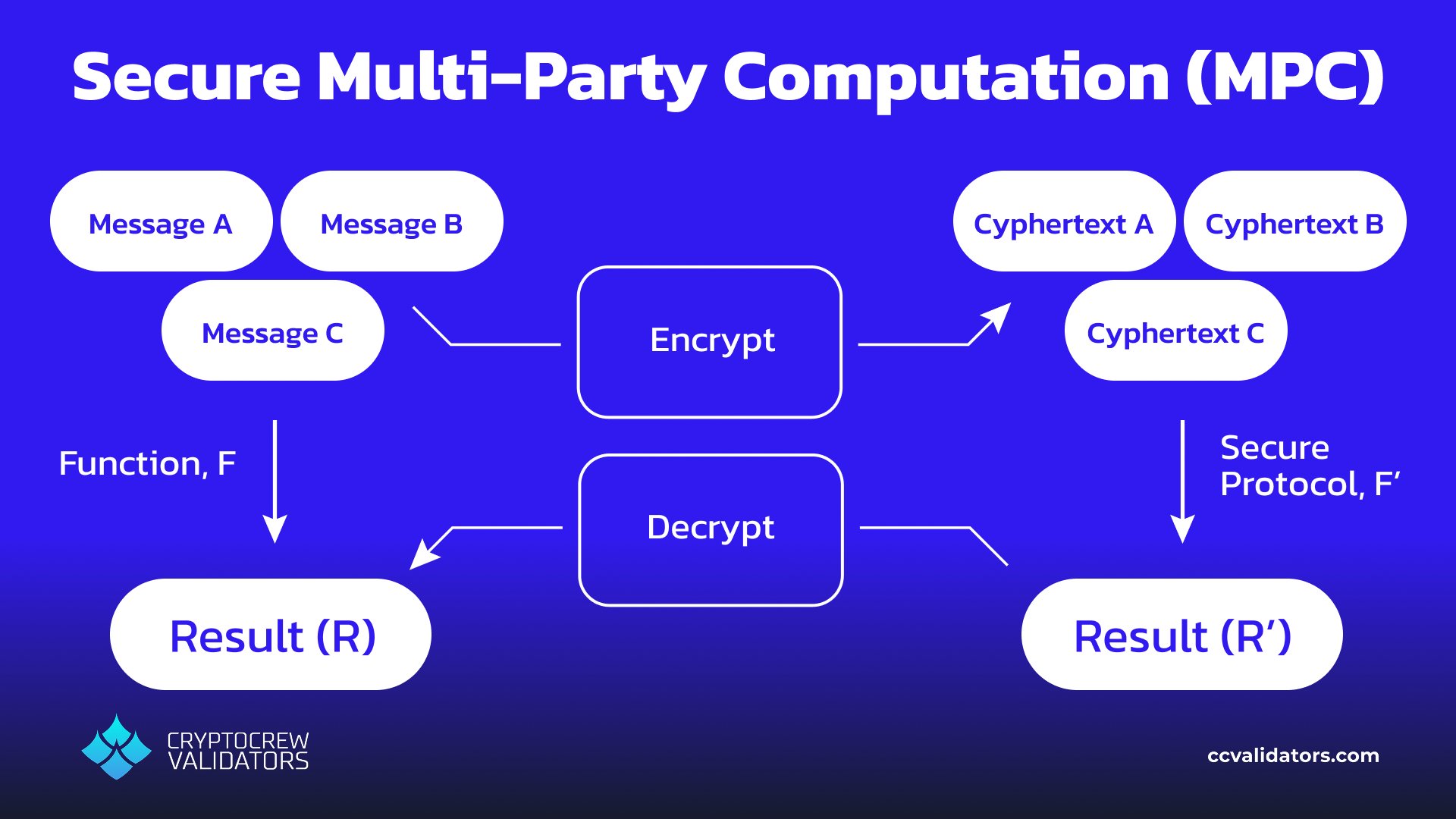

Use):保護數據在記憶體中被處理時的安全,這是最具挑戰性的,相關技術如同態加密、安全多方計算(SMPC)、可信執行環境(TEE)等。靜態數據加密是確保大數據儲存安全的基本要求。

#13

★★★

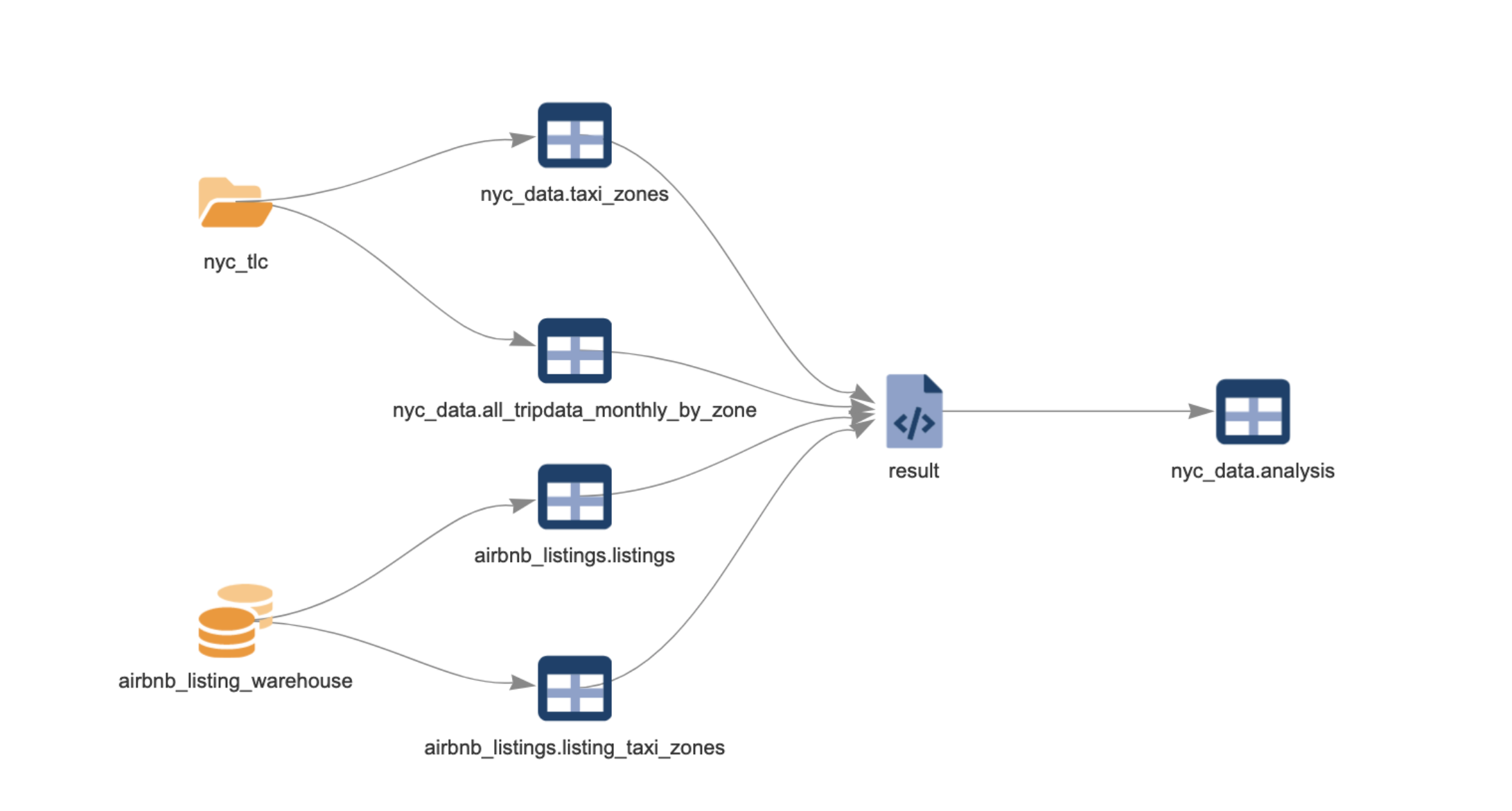

在進行大數據分析或AI模型訓練時,數據血緣(Data Lineage)追蹤的主要目的是什麼?

答案解析

數據血緣記錄了數據從起源到最終應用的完整生命週期路徑。它回答了諸如「這個分析結果的數據來自哪裡?」、「數據經過了哪些清洗和轉換規則?」、「如果源數據發生變化,會影響哪些下游報表或模型?」等問題。數據血緣對於:(1) 理解和信任數據至關重要;(2) 當發現數據錯誤或分析結果異常時,能夠快速定位問題根源;(3) 滿足某些行業(如金融、醫療)的合規性要求,需要證明數據的處理過程;(4) 評估數據變更可能帶來的影響範圍。在大數據和複雜AI流程中,自動化的數據血緣追蹤是數據治理的重要組成部分。

#14

★★★★

AI系統的「黑盒子」(Black

Box)問題,即難以解釋模型為何做出特定決策,這在大數據驅動的應用(如信貸審批、醫療診斷)中可能引發哪項主要的倫理和合規擔憂?

答案解析

許多先進的AI模型(尤其是深度學習模型)內部運作機制複雜,很難讓人們理解它們是如何根據輸入數據得出特定輸出的。這種「黑盒子」特性在影響重大的決策場景中會產生問題:(1) 如果模型存在偏見,很難發現其根源並加以修正。(2) 當模型出錯時,難以確定責任歸屬。(3)

對於受到不利決策影響的個人(如被拒絕貸款),無法提供清晰的理由,可能侵犯其知情權。(4) 某些法規(如GDPR第22條)限制了完全基於自動化處理的決策,並要求提供解釋。因此,提高AI的可解釋性(Explainable AI, XAI)是應對這些倫理和合規挑戰的重要研究方向。

#15

★★★★

在雲端環境中使用託管的資料庫或數據湖服務時,哪種加密方式可以確保即使雲服務提供商的員工也無法讀取客戶的敏感數據?

答案解析

雖然雲服務提供商通常會提供服務端加密選項(即數據在到達雲端後由提供商負責加密),但如果密鑰由提供商管理(如SSE-S3或SSE-KMS),理論上提供商(或擁有足夠權限的內部員工、或應政府要求)仍然可能訪問解密密鑰並讀取數據。客戶端加密則是在數據離開客戶控制範圍之前,就使用客戶自己持有和管理的密鑰進行加密。這樣,上傳到雲端的數據本身就是密文,雲服務提供商沒有密鑰,無法解密。這提供了最高級別的數據保密性控制,但客戶需要自行負責密鑰管理的安全性和複雜性。傳輸中加密只保護數據在網路上的傳輸過程。

#16

★★★

台灣的「個人資料保護法」(個資法)規範了個人資料的收集、處理及利用。根據個資法,企業在收集個人資料前,通常需要履行什麼義務?

答案解析

台灣個資法第8條和第19條規定,非公務機關在收集個人資料時,應明確告知當事人法定的應告知事項(如收集者的名稱、收集目的、個資類別、利用的期間/地區/對象/方式、當事人可行使的權利及方式、不提供個資的影響等),並且除非符合特定例外情形(如法律明文規定、契約關係所必需、當事人自行公開等),原則上需要取得當事人的書面同意。這是個資法中保護個人資訊自主權的核心要求之一。

#17

★★★

數據遮罩(Data Masking)是一種常用的去識別化技術,其主要操作方式是?

答案解析

數據遮罩旨在創建一個與原始數據集結構相似但敏感訊息已被替換的版本,常用於軟體測試、開發或分析場景,以便在不暴露真實敏感數據的情況下使用數據。遮罩技術可以包括替換(Substitution,用來自預定義列表或隨機生成的值替換)、洗牌(Shuffling,在列內隨機打亂值)、模糊化(Blurring/Masking Out,如顯示部分信用卡號)、數值變異(Number Variance,如對薪資添加隨機變動)等。其目標是在保護隱私的同時,盡可能保留數據的格式和一定的統計特性,以便下游應用可以正常工作。

#18

★★★

差分隱私(Differential Privacy)可以應用在機器學習模型訓練的哪個環節以保護訓練數據的隱私?

答案解析

將差分隱私應用於機器學習訓練(特別是深度學習)的一個主要方法是差分隱私隨機梯度下降(Differentially Private

Stochastic Gradient Descent, DPSGD)。在標準的SGD中,模型參數是基於每個批次數據計算出的梯度來更新的。在DPSGD中,首先要限制單個樣本梯度對總體梯度的貢獻(梯度裁剪),然後在聚合的梯度上添加符合差分隱私要求的高斯或拉普拉斯噪聲,最後才用加噪後的梯度來更新模型參數。這樣可以確保最終訓練出的模型參數對於訓練集中是否存在任何單個樣本不敏感,從而保護了訓練數據的隱私。

#19

★★★★

滲透測試(Penetration Testing)是一種評估大數據系統或應用程式安全性的方法,其主要目的是?

答案解析

滲透測試,也稱為道德駭客(Ethical Hacking),是一種主動的安全評估活動。測試人員會扮演攻擊者的角色,使用各種工具和技術(如掃描、漏洞利用、社會工程學等)試圖突破目標系統的安全防線,例如獲取未授權訪問權限、竊取數據或造成服務中斷。其目的是在真正的攻擊者利用這些漏洞之前,識別出系統中存在的弱點,並提供修復建議,從而提高系統的整體安全性。

#20

★★

在大數據治理中,「元數據管理」(Metadata

Management)指的是什麼?

答案解析

元數據是描述數據的結構化訊息。在大數據環境中,由於數據量龐大、來源多樣、格式複雜,有效的元數據管理變得至關重要。它有助於:(1) 數據發現:幫助用戶找到他們需要的數據。(2) 數據理解:提供數據的上下文訊息,如業務定義、計算邏輯。(3) 數據治理:記錄數據擁有者、品質標準、安全分類、合規要求等。(4) 數據整合:促進不同數據源之間的集成。(5) 數據血緣:追蹤數據的來龍去脈。數據目錄(Data

Catalog)是實現元數據管理的常用工具。

#21

★★★

「告知同意」(Informed Consent)是數據隱私和倫理中的一個重要原則。在大數據研究或應用中,實現真正「告知」的挑戰之一是?

答案解析

告知同意要求在收集個人數據前,向數據主體提供足夠的訊息,使其能夠在充分了解情況下自主決定是否同意數據被收集和使用。然而,在大數據和AI時代,這一原則面臨挑戰:(1)

數據用途的複雜性:向非專業用戶解釋數據將如何被用於訓練複雜的AI模型、可能產生哪些推斷、以及潛在的偏見或隱私風險,本身就很困難。(2)

用途的不可預見性:大數據往往具有二次利用的價值,收集時可能無法完全預知未來的所有用途。(3) 隱私政策冗長難懂:用戶很少會仔細閱讀冗長、充滿法律術語的隱私政策。這些因素使得如何設計真正有效、易懂的告知和同意機制成為一個持續的倫理和實踐挑戰。

#22

★★★

在多租戶(Multi-tenant)的雲端大數據平台上,一個潛在的安全風險是?

答案解析

多租戶架構允許多個不同的客戶(租戶)共享相同的雲基礎設施和資源。雖然這可以帶來成本效益和可擴展性,但也引入了新的安全挑戰。必須確保租戶之間有嚴格的隔離機制,防止一個租戶能夠訪問或干擾另一個租戶的數據或計算資源。如果隔離措施不足或存在漏洞,就可能發生跨租戶的數據洩露或攻擊。此外,「吵鬧鄰居」(Noisy

Neighbor)問題也可能出現,即一個租戶過度消耗資源而影響其他租戶的性能。因此,雲服務提供商需要實施強健的隔離、訪問控制和資源管理機制,而客戶也需要了解並配置好相關的安全設置。

#23

★★★★

個人身份資訊(Personally Identifiable Information, PII)通常指可以用來識別特定個人的資訊。以下哪一項最可能「不」被視為典型的PII?

答案解析

PII是指任何可以用來直接或間接識別、聯繫或定位單一個人的資訊。典型的PII包括姓名、身分證字號、駕照號碼、護照號碼、電話號碼、電子郵件地址、家庭住址、生物特徵數據(如指紋、人臉識別特徵)、醫療記錄、財務帳號等。而經過適當匿名化處理的、聚合的統計數據,如果無法反向推導出任何個體的訊息,則通常不被視為PII。例如,網站的總訪問量或用戶平均停留時間等宏觀統計數據,本身不直接指向任何特定個人。

#24

★★★

泛化(Generalization)是k-匿名等匿名化技術中常用的一種方法,它是指?

答案解析

泛化是降低數據精度以實現匿名保護的一種手段。通過將具體的數值或分類屬性替換為一個更一般化的類別或範圍,可以使得多條記錄在該屬性上變得不可區分。例如,將年齡32歲、34歲、35歲都泛化為「30-39歲」;將郵遞區號「106」泛化為「台北市」。通過對準標識符進行適當的泛化,可以使得滿足k-匿名要求的等價類更容易形成。泛化的程度越高,隱私保護越強,但數據的可用性通常會下降。另一種常用方法是抑制(Suppression),即直接隱藏或刪除某些值。

#25

★★★

安全多方計算(Secure Multi-Party Computation, SMPC)是一種密碼學技術,它允許一組參與方共同計算一個函數,而無需向彼此透露各自的私有輸入數據。這在協作式大數據分析或AI模型訓練中,可以達到什麼目的?

答案解析

SMPC 允許 N 個參與方,每個持有私有數據 xi,共同計算一個他們都感興趣的函數 f(x1, x2,

..., xN),最終得到正確的計算結果 y,但在此過程中,任何參與方(或少數勾結的參與方)都無法得知其他參與方的私有輸入數據

xi(除了從最終結果y中可能推斷出的訊息外)。這使得多個互不信任的機構(如銀行、醫院)可以在不共享原始敏感數據的情況下,進行聯合的數據分析或模型訓練,從而實現隱私保護下的協作。然而,SMPC

通常也伴隨著較高的通信和計算開銷。

#26

★★★

日誌管理(Log

Management)系統(如 ELK Stack: Elasticsearch, Logstash,

Kibana 或 Splunk)在大數據安全中的主要作用是?

答案解析

現代IT系統會產生海量的日誌數據(如操作系統日誌、應用日誌、網路設備日誌、安全設備日誌)。日誌管理系統的核心功能是將這些分散的、格式各異的大數據日誌進行集中採集、解析、索引和儲存,並提供強大的搜索、分析和視覺化能力。在安全領域,這使得安全團隊能夠:(1) 實時監控可疑活動或異常模式。(2) 在發生安全事件(如數據洩露、入侵)後,進行調查和追溯,了解攻擊路徑和影響範圍。(3) 生成報表以滿足合規性審計要求(如記錄訪問控制、系統變更等)。有效的日誌管理是建立縱深防禦和快速響應能力的基礎。

#27

★★★

當使用大數據訓練的AI模型被用於可能影響個人權利(如就業、信貸)的決策時,若模型產生了歧視性結果,問責性(Accountability)原則要求什麼?

答案解析

問責性是負責任AI的核心原則之一。它意味著對於AI系統在其整個生命週期中的行為及其產生的後果,應該有相應的責任機制。當AI系統造成損害或做出不公平的決策時,需要能夠追溯原因,明確由誰負責(可能涉及數據提供者、模型開發者、系統部署者、最終用戶等多方),並建立相應的申訴、審查和補救程序。缺乏問責性會削弱公眾對AI技術的信任,阻礙其健康發展。實現問責性需要技術措施(如可解釋性、日誌記錄)和治理框架(如明確的責任分配、審計機制)的結合。

#28

★★

在雲端環境中管理大數據平台的身份和訪問權限時,建議採用哪個安全原則來限制用戶或服務的權限?

答案解析

最小權限原則是一項基礎且重要的安全最佳實踐。它要求給予每個用戶、應用程式或服務僅僅完成其指定任務所必需的最小權限集合。這樣做可以顯著降低因帳號被盜用、內部人員誤操作或惡意行為、以及軟體漏洞被利用所造成的潛在損害範圍。例如,一個只需要讀取數據進行分析的應用程式,就不應該被授予修改或刪除數據的權限。在複雜的雲端和大數據環境中,實施精細化的最小權限訪問控制對於保護數據和系統安全至關重要。

#29

★★

數據生命週期管理(Data Lifecycle Management, DLM)涉及數據從創建到銷毀的整個過程。在隱私保護和合規性方面,DLM的一個關鍵環節是?

答案解析

無限期地保留數據不僅會增加儲存成本,更重要的是會帶來持續的隱私和安全風險,也可能違反某些法規(如GDPR的儲存限制原則)。有效的DLM策略需要明確定義不同類型數據需要保留多長時間(基於法律規定、行業標準或業務價值),並在保留期滿後,實施可靠的數據銷毀或深度匿名化程序。這有助於降低數據洩露的風險、減少不必要的儲存開銷,並確保遵守相關的數據保留和刪除要求。

#30

★★

l-多樣性(l-Diversity)是對k-匿名模型的改進,它要求在每個等價類(具有相同準標識符的記錄組)中,敏感屬性(如疾病、薪資)的值至少具有多少種不同的取值?

答案解析

k-匿名雖然能防止基於準標識符的記錄鏈接攻擊,但如果一個等價類中的所有記錄都具有相同的敏感屬性值(例如,某個等價類中的10個人都患有同一種疾病),那麼攻擊者即使不知道具體是誰,也能推斷出該等價類中個體的敏感訊息(同質性攻擊)。l-多樣性旨在解決這個問題,它要求每個等價類中敏感屬性的值至少要有 l 種不同的、且分佈不能過於集中的取值(「良好表示」有多種定義,如Distinct l-Diversity要求至少有l個不同值)。這增加了攻擊者推斷個體敏感訊息的難度。t-相近性(t-Closeness)則是更進一步的要求,要求每個等價類中敏感屬性的分佈與整個數據集的分佈足夠接近。

#31

★★

差分隱私通常通過添加噪聲來實現。以下哪種噪聲分佈常用於滿足差分隱私的要求,尤其是在處理計數或數值型查詢時?

答案解析

為了滿足差分隱私的數學定義,添加的噪聲需要具有特定的機率分佈特性。拉普拉斯機制(Laplace

Mechanism)常用於響應數值型查詢(如計數、求和、平均值),它添加從拉普拉斯分佈中抽樣的噪聲,噪聲的大小與查詢的L1敏感度成正比,與隱私預算ε成反比。高斯機制(Gaussian

Mechanism)則常用於L2敏感度的查詢或在滿足(ε, δ)-差分隱私(一種稍微放鬆的定義)時使用,它添加從高斯分佈中抽樣的噪聲。選擇哪種機制和分佈取決於具體的查詢類型和所需的隱私定義。

#32

★★

除了聯邦學習,還有哪些技術可以在不共享原始數據的情況下進行協作式大數據分析或模型訓練,以保護隱私?

答案解析

隱私增強技術(Privacy-Enhancing

Technologies, PETs)是一個不斷發展的領域。除了聯邦學習,其他關鍵技術包括:(1) 安全多方計算(SMPC):允許多方聯合計算而不洩露各自輸入。(2) 同態加密(HE):允許在密文上進行計算。(3) 可信執行環境(TEE):提供硬體級別的安全隔離區來執行計算,保護代碼和數據的機密性與完整性,即使操作系統或管理程序被攻破。這些技術各有優缺點,有時會結合使用(例如,聯邦學習結合差分隱私或SMPC)以提供更強的隱私保護。

#33

★★

資料外洩防護(Data Loss Prevention, DLP)系統旨在監控和阻止敏感數據未經授權地離開組織的控制範圍。DLP系統通常依賴於什麼技術來識別敏感數據?

答案解析

DLP系統的核心能力在於識別流動中(in

motion, 如電子郵件、網頁上傳)、使用中(in use, 如複製到USB)或靜態(at rest,

儲存中)的數據是否包含敏感訊息。它通常採用多種內容檢測技術:(1) 關鍵字匹配和正則表達式:查找特定的詞語或模式(如身分證字號格式)。(2) 數據指紋:對已知的敏感文件或資料庫記錄創建哈希或指紋,然後比對數據流中是否存在匹配。(3) 精確數據匹配(EDM):比對結構化數據源(如客戶資料庫)。(4) 機器學習:訓練分類器來識別更廣泛的敏感內容(如財務報告、原始碼)。基於檢測結果,DLP系統可以觸發告警、阻止傳輸、加密或隔離等策略。

#34

★★★★

美國加州的「消費者隱私法案」(California Consumer Privacy Act, CCPA)及其後續修訂(如CPRA),與歐盟GDPR有相似之處,賦予了加州居民對其個人資訊的某些權利。下列哪項是CCPA/CPRA賦予的關鍵權利之一?

答案解析

CCPA及其修訂案CPRA是美國加州重要的消費者隱私保護法。它賦予加州居民一系列權利,核心包括:(1) 知情權:了解企業收集、使用、共享其個人資訊的詳細情況。(2) 訪問權:有權訪問企業持有的關於他們的具體個人資訊。(3) 刪除權:在特定條件下要求企業刪除其個人資訊。(4) 選擇退出權:有權要求企業不「出售」或「共享」(用於跨場景行為廣告等目的)其個人資訊。(5) 更正權(由CPRA引入)。(6) 限制使用敏感個人資訊的權利(由CPRA引入)。(7)

不受歧視權:行使隱私權時不受企業歧視。這些權利對處理加州居民大數據的企業提出了明確的合規要求。

#35

★★

在設計和部署使用大數據的AI系統時,僅僅遵守法律法規是否就足夠確保系統符合倫理要求?

答案解析

法律通常設定了行為的最低標準,而倫理則涉及更廣泛的是非對錯、公平正義、以及對個人和社會福祉的考量。在快速發展的AI和大數據領域,法律往往滯後於技術發展,可能無法涵蓋所有新出現的倫理困境。例如,某種利用用戶數據進行精準定向(或操縱)的方式可能在法律上沒有明確禁止,但可能被公眾或倫理學家認為是不道德的或具有潛在危害。因此,負責任的AI開發和部署不僅要遵守法律底線,還需要積極考慮更廣泛的倫理原則,如公平性、透明度、問責性、人類福祉等。

#36

★★★

雲端服務提供商通常提供「數據駐留」(Data

Residency)或「數據主權」(Data Sovereignty)相關的選項或服務,這主要是為了幫助客戶滿足哪個方面的要求?

答案解析

許多國家或地區出於主權、安全或隱私保護的考慮,制定了法律法規,要求特定類型(如政府數據、金融數據、個人數據)必須儲存在該國或地區的物理邊界內,並且可能受到該國法律的管轄(數據主權)。雲服務提供商為了幫助客戶滿足這些合規性要求,通常會提供選項讓客戶可以指定其數據儲存和處理的地理位置(數據駐留),例如,可以選擇將數據只儲存在位於德國的數據中心。這對於在全球範圍內運營並處理受地域限制數據的企業至關重要。

#37

★

「隱私影響評估」(Privacy Impact Assessment, PIA)或「數據保護影響評估」(Data Protection Impact Assessment, DPIA - GDPR要求)是一種什麼樣的流程?

答案解析

PIA/DPIA

是一種風險管理工具,旨在幫助組織主動思考和解決與個人數據處理相關的隱私問題。當組織計劃啟動一個可能對個人隱私產生較高風險的新項目時(例如,引入新的監控技術、處理大量敏感數據、進行大規模用戶剖析等),進行PIA/DPIA可以幫助其:(1)

描述數據處理活動。(2) 評估其必要性和相稱性。(3) 識別可能對個人權利和自由產生的風險(如數據洩露、歧視、監控)。(4) 規劃用於應對這些風險的措施(如安全控制、匿名化、最小化數據收集)。這是實現「設計即隱私」(Privacy by

Design)原則的重要實踐,也是某些法規(如GDPR)在特定情況下的強制要求。

#38

★

差分隱私可以提供強有力的隱私保護,但其主要缺點或挑戰之一是?

答案解析

差分隱私的核心是通過添加噪聲來模糊個體貢獻,但這種噪聲不可避免地會影響最終結果的精度。隱私保護程度(由ε決定)和數據效用之間存在固有的權衡:要求更高的隱私保護(更小的ε),通常需要添加更多的噪聲,這會使得分析結果(如統計數據、模型參數)與真實值之間的偏差更大,從而降低其可用性。如何在滿足隱私要求的同時,最大化數據效用,是差分隱私研究和應用中的一個關鍵挑戰。尤其對於複雜分析或需要高精度的場景,找到合適的平衡點可能很困難。

#39

★★★

在保護大數據系統免受惡意軟體(Malware)或勒索軟體(Ransomware)攻擊時,除了安裝防毒軟體,還應採取哪項關鍵的預防措施?

答案解析

勒索軟體攻擊會加密受害者的數據,並要求支付贖金才能解密。即使有防毒軟體,也無法保證100%攔截所有攻擊。因此,擁有可靠的數據備份是應對勒索軟體和其他數據丟失事件(如硬體故障、誤刪除)的最後一道防線。關鍵在於:(1) 定期備份重要數據。(2) 將備份數據儲存在與主系統隔離的地方(例如,離線儲存、不同的網路段或雲儲存帳戶),以防備份也被加密。(3) 定期測試備份數據的可恢復性,確保在需要時能夠成功還原。這樣,即使系統被攻擊,也可以從乾淨的備份中恢復數據,而無需支付贖金。

#40

★★★

在數據治理和安全中,「數據分類」(Data Classification)指的是什麼過程?

答案解析

組織通常擁有多種類型的數據,其敏感程度和價值各不相同。數據分類是一個基礎性的治理和安全實踐,它要求組織定義一套分類標準(例如,基於數據內容、創建者、法規要求等),並將其數據資產歸入適當的類別。例如,可以將數據分為「公開」(Public)、「內部使用」(Internal)、「機密」(Confidential)、「高度機密」(Highly

Confidential)等級別。一旦數據被分類,就可以根據其級別應用差異化的安全策略,如更嚴格的訪問控制、加密要求、審計記錄、保留期限等。這有助於將有限的安全資源集中用於保護最關鍵和最敏感的數據。

#41

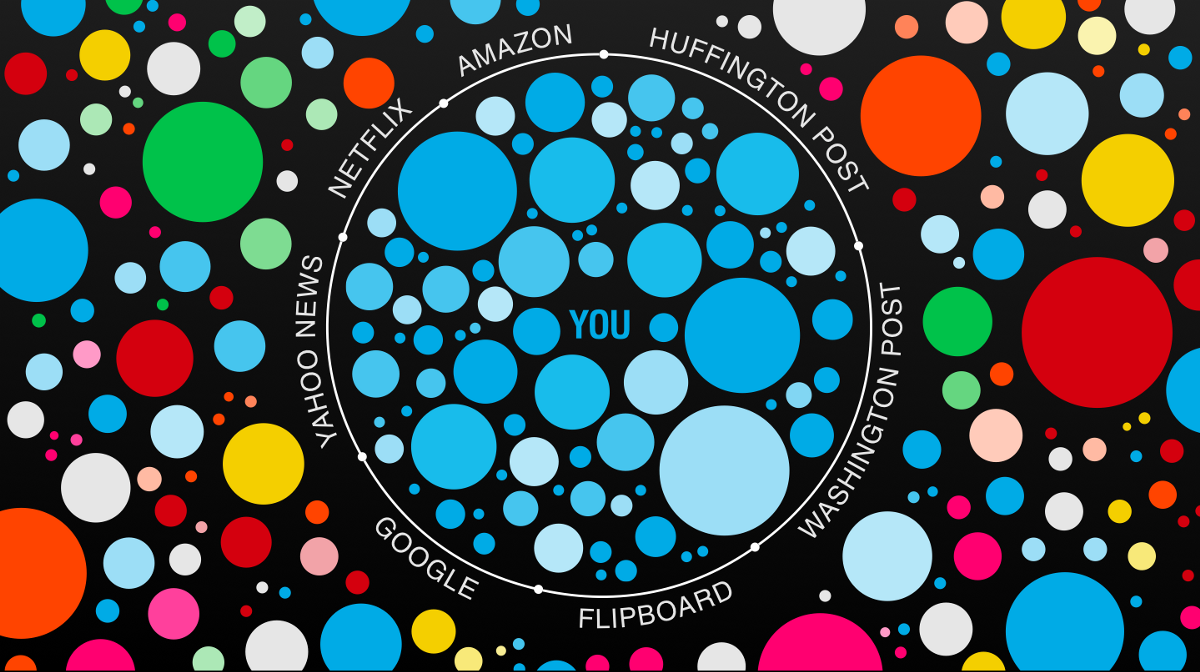

★★★★

使用用戶的大量歷史行為數據(如瀏覽記錄、購買記錄)來訓練個性化推薦系統或廣告系統,雖然可以提高用戶體驗或商業效益,但也可能引發「過濾氣泡」(Filter Bubble)或「迴聲室效應」(Echo

Chamber)。這主要涉及哪個倫理問題?

答案解析

個性化算法通過學習用戶的偏好,傾向於向用戶展示他們可能感興趣或同意的內容,同時過濾掉他們可能不感興趣或不同意的內容。雖然這在短期內可能提高用戶參與度,但長期來看,可能導致用戶陷入「過濾氣泡」(只看到符合自己興趣的訊息)或「迴聲室」(只聽到與自己觀點一致的聲音)中,缺乏接觸多元觀點和訊息的機會。這不僅可能限制個人的認知發展和批判性思維能力,也可能加劇社會群體之間的隔閡和極化。如何在提供個性化服務的同時,確保訊息的多樣性、促進健康的公共討論,是算法倫理需要解決的重要問題。

#42

★

在雲端環境下使用第三方提供的SaaS(軟體即服務)大數據分析平台時,客戶在數據隱私和安全方面應特別關注什麼?

答案解析

當使用SaaS服務時,客戶將其數據託管和處理的很大一部分控制權交給了服務提供商。因此,在選擇和使用SaaS平台(尤其涉及處理敏感大數據時)之前,進行充分的盡職調查至關重要。客戶需要了解並評估提供商:(1)

如何保護客戶數據的機密性、完整性和可用性?(安全措施)(2) 如何處理個人數據?是否符合相關隱私法規?(隱私政策、DPA)(3)

是否通過了獨立的第三方安全和合規性審計?(合規認證)(4)

數據儲存在哪裡?(5) 服務水平協議(SLA)如何規定?等等。不能假設SaaS提供商會自動滿足所有的安全和隱私需求,客戶需要主動確認和配置。

#43

★★★

根據GDPR,對於處理敏感個人數據(如健康資訊、種族、宗教信仰等),通常需要比處理一般個人數據更嚴格的條件。以下哪項通常是處理敏感數據的合法基礎之一?

答案解析

GDPR第9條原則上禁止處理特定類別的敏感個人數據(Special Categories of

Personal Data)。然而,該條款也列出了一些例外情況,允許在滿足特定條件下處理敏感數據。其中最常見的合法基礎之一是獲得數據主體的「明確同意」。這意味著同意必須是自由給予、具體、知情且毫不含糊的表示,通常需要通過明確的肯定性行為(如勾選框、簽名)來表達,其要求比處理一般個人數據所需的一般同意更高。其他可能的合法基礎包括履行特定領域的法律義務(如就業、社會保障)、保護重大利益、處理已由數據主體明顯公開的數據、法律索賠、重大公共利益、預防醫學或職業醫學、公共衛生以及存檔/研究目的(需有適當保障措施)等。

#44

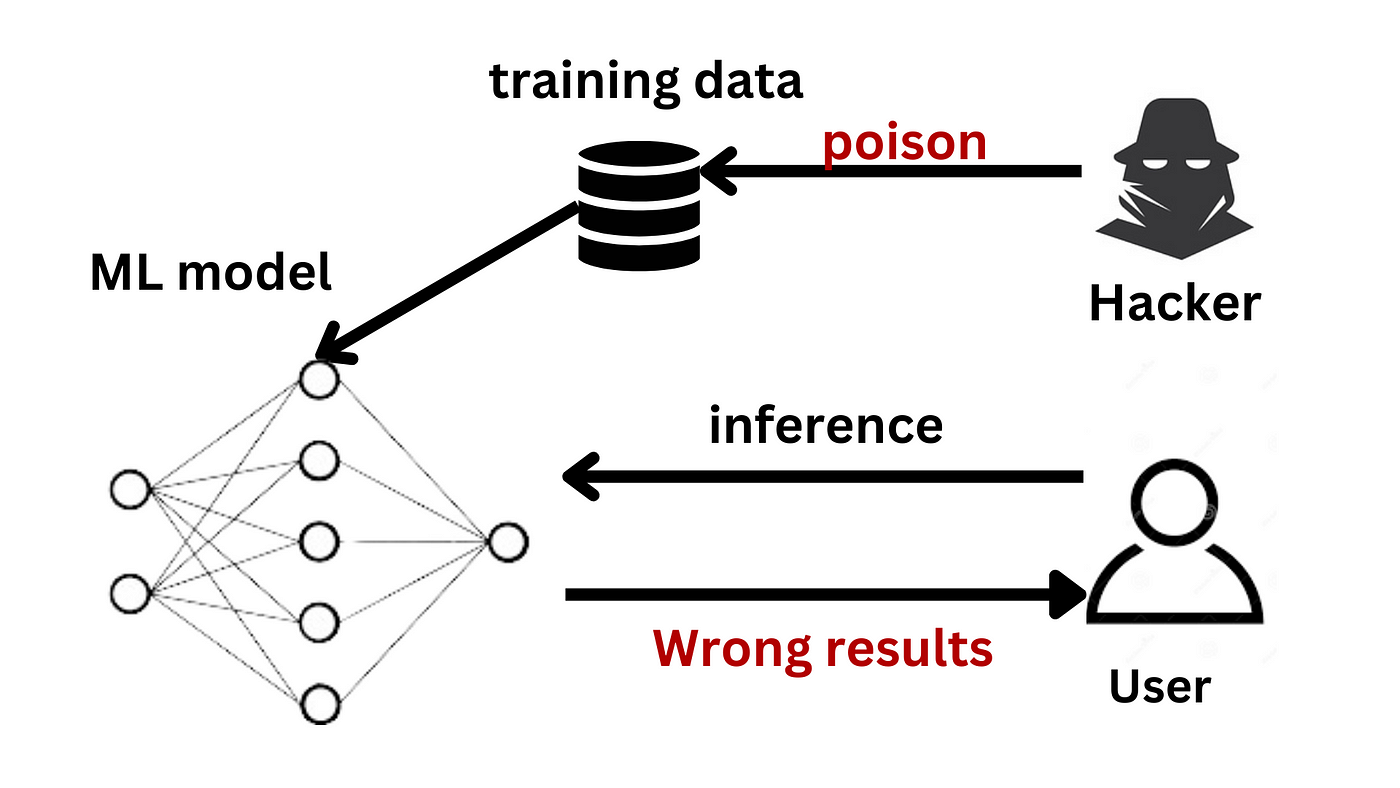

★

在聯邦學習中,中央伺服器聚合來自客戶端的模型更新時,如果直接平均權重,惡意客戶端可能通過提交精心構造的惡意更新來影響全局模型的性能或植入後門。這類針對聯邦學習的攻擊被稱為什麼?

答案解析

模型毒化攻擊是指惡意參與者試圖通過操縱訓練數據或訓練過程來破壞最終訓練出的模型的性能或使其產生特定錯誤行為。在聯邦學習的背景下,惡意客戶端可以發送惡意的模型更新(例如,與良性更新方向相反的梯度,或旨在植入特定觸發器後門的梯度),試圖污染聚合後的全局模型。拜占庭攻擊則泛指在分散式系統中,部分節點可能出現任意(惡意或故障)行為,影響系統的正確性。為了防禦這類攻擊,聯邦學習需要採用更穩健的聚合演算法(如過濾異常更新、基於信任度加權等)以及可能的客戶端驗證機制。

#45

★

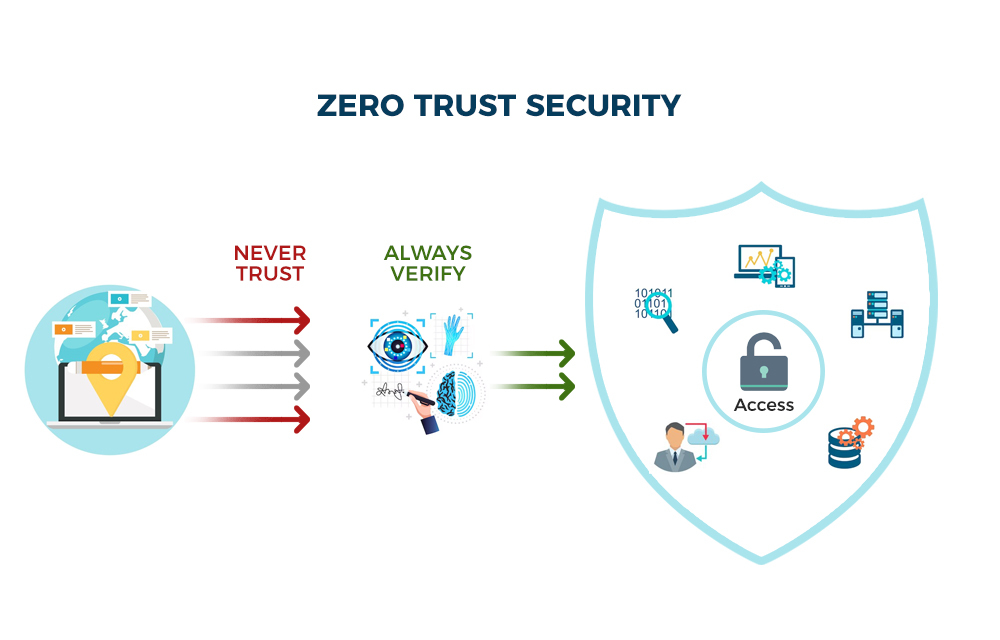

零信任(Zero

Trust)是一種現代網路安全模型,其核心理念是?

答案解析

傳統的安全模型通常基於邊界防禦,認為網路內部是可信的,外部是不可信的。然而,隨著雲計算、移動辦公和內部威脅的增加,這種模型已不再足夠。零信任模型採取了「從不信任,始終驗證」(Never

Trust, Always Verify)的方法。它假設網路無處安全,任何訪問資源(數據、應用、基礎設施)的請求,無論來自何處,都必須先經過嚴格的身份驗證(基於用戶、設備、位置、行為等多重因素),然後根據動態評估的風險和策略,授予最小化的訪問權限。這是一種更精細化、更持續的安全方法,有助於更好地保護現代分散式環境(包括大數據平台)的安全。

#46

★

「數據最小化」(Data Minimization)原則,作為數據隱私和治理的關鍵概念,其含義是?

答案解析

數據最小化是GDPR等隱私法規中的核心原則之一。它要求組織在收集和處理個人數據時,應確保數據是充分的(adequate)、相關的(relevant)且限於實現特定處理目的所必需的(limited to what is necessary)。換句話說,不應收集超出當前明確且合法目的範圍的額外數據。遵循數據最小化原則有助於:(1) 降低數據洩露或濫用的風險(因為持有的敏感數據更少)。(2) 減輕數據管理的負擔。(3)

提高數據處理的合規性。這與傳統大數據「收集一切以備不時之需」的思路有所不同,強調了更有目的性和責任感的數據處理方式。

#47

★

在AI倫理討論中,「人類福祉」(Human

Well-being)原則強調AI系統的開發和部署應以什麼為目標?

答案解析

許多AI倫理指南都將促進人類福祉作為核心目標。這意味著AI技術的發展和應用應旨在造福人類和社會,例如提高生活質量、增進健康、擴大機會、保護環境等。同時,也必須積極預見和減輕AI可能帶來的負面影響和風險,如失業、歧視、隱私侵犯、安全威脅或社會不平等等。這要求在AI的設計、開發、部署和治理過程中,始終將人的價值、權利和福祉置於中心地位。

#48

★★

為了保護在公有雲上儲存和處理的大數據,除了雲服務提供商提供的安全功能外,客戶還應該實施哪些自身的安全最佳實踐?

答案解析

根據責任共擔模型,客戶對其在雲中的數據和應用安全負有主要責任。關鍵的最佳實踐包括:(1)

強身份驗證:使用強密碼,並為所有特權帳戶啟用MFA。(2) 精細化權限管理:遵循最小權限原則,使用IAM精確控制用戶和服務對資源的訪問。(3) 數據加密:考慮使用客戶管理的密鑰進行客戶端加密或服務端加密。(4)

網路安全:配置好虛擬私有雲(VPC)、安全組和網路ACL。(5) 安全監控與日誌:啟用並配置雲平台提供的監控、日誌和告警服務(如AWS CloudTrail, CloudWatch; Azure Monitor;

GCP Cloud Logging/Monitoring),以便及時發現和響應安全事件。(6) 定期審計:定期檢查權限配置和安全設置。僅僅依賴提供商的基礎設施安全是不夠的。

#49

★

「設計即隱私」(Privacy by Design, PbD)的核心理念是在產品或服務設計開發的哪個階段就開始考慮和嵌入隱私保護措施?

答案解析

設計即隱私(PbD)由加拿大安大略省前訊息與隱私專員 Ann

Cavoukian 博士提出,包含七項基礎原則。其核心思想是將隱私保護作為系統設計的預設和基礎要求,而不是事後補救或附加的功能。這意味著在構思、設計、開發和部署任何涉及個人數據的系統、流程或產品時,都要從一開始就主動地、系統性地將隱私考量和保護措施(如數據最小化、目的限制、安全保障、透明度、用戶控制權等)融入其中。這種預防性的方法比在問題出現後再試圖修復要有效得多,也更符合現代隱私法規的精神(如GDPR明確將PbD和預設即隱私 Privacy by Default

作為要求)。

#50

★★

對大數據平台進行定期的漏洞掃描(Vulnerability

Scanning)有助於發現哪些潛在的安全問題?

答案解析

漏洞掃描是使用自動化工具來檢查計算機系統、網路或應用程式,以查找已知安全弱點的過程。這些弱點可能包括:(1) 過時的軟體版本中存在的已知漏洞(通常以CVE編號標識)。(2) 不安全的配置,例如開放了不必要的端口、使用了預設密碼、權限設置過於寬鬆等。(3)

缺少必要的安全補丁。定期進行漏洞掃描並及時修補發現的問題,是降低系統被攻擊風險的基礎性安全措施之一,有助於在攻擊者利用這些漏洞之前將其封堵。

↑